Lexpresse de la Banque Postale - Privacy et Big Data

-

Upload

antoine-vigneron -

Category

Technology

-

view

303 -

download

0

Transcript of Lexpresse de la Banque Postale - Privacy et Big Data

pparue à la fin des années 90,l’expression Big Data (ou méga-

données dans sa traduction française) vise les traitements de données de masse. Plus précisément, le Big Data se caractérise par sa capacité à traiter, à très grande vitesse, des quantités considérables de données is-sues de sources multiples (réseaux sociaux, bases de données clients, objets connectés, etc.). Le phénomène n’est, en soi, pas nouveau. La nouveauté est que, depuis une dizaine d’années, il est possible d’exploiter ce déluge de données car le Big Data est porté par des innovations technologiques majeures (architecture CPU multi-cœurs, traitements in-memory, parallélisation massive, bases de données noSQL). Ainsi l’exploitation de la donnée vient bouleverser nos modèles d’affaires. Les enjeux économiques sont colossaux. Le chiffre d’affaires estimé des mégadonnées était de 8,9 milliards de dollars en 2014 et 24,6 milliards de dollars sont attendus en 20161. Avec le Big Data, le marketing comportemental se développe et ses nouvelles disciplines, comme le geofencing ou le wait-marketing, permettent de nous pousser l’offre au moment opportun. Avec le Big Data, stopper la fraude avant qu’elle ne se commette c’est possible : voici le Minority report, façon Banque. Si le Big Data ne se traduit pas par un Big Bang immédiat sur tout l’univers de la donnée, les usages et les applications se multiplient.

A ces enjeux commerciaux majeurs, répondent des enjeux juridiques qui ne le sont pas moins dans un environnement appelé à évoluer très rapidement2. La règlementation est-elle Big Data compatible ? Quid de la sécurité des données à caractère personnel dans un contexte sans cesse plus exigeant? Au-delà des problématiques réglemen-taires, le Big Data pose la question de la confiance et celle de la transparence dans l’utilisation des informations. Or, la confiance est un capital qui s’accumule lentement, mais qui est extrêmement volatil : « La confiance se gagne en gouttes et se perd en litres » (Jean-Paul Sartre). Comment faire pour bien faire, nous qui portons dans notre ADN la confiance ?

Par-delà l’économique et le juridique, se profilent aussi des questions de société. Quid de la notion de propriété des données numériques devenues des « marchandises » après avoir été exposées sur les réseaux sociaux ? L’éthique sera-t-elle un frein ou bien un guide pour une mise en œuvre responsable du Big Data ?

De toute évidence, et comme l’illustre tout ce questionnement, le Big Data amène à repenser le domaine d’application des lois et des règlementations pour protéger, au-delà de leurs données, les personnes et leur vie privée.

(1) Transparency Market Research « Big Data Market – Global Scenario, Trends, Industry Analysis, Size, Share and Forecast 2012-2018 ».(2) Le Règlement européen relatif aux données personnelles est attendu fin 2015.

A

A LIRE PAGE 2

FAUT-IL CRÉER UN DROIT DES ALGORITHMES?

A LIRE PAGES SUIVANTES

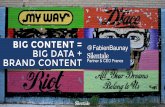

Pour faire du Big Data, il faut des données de toutes sortes ; structurées, semi-structurées,

non structurées (Variété), en grandes quantités (Volume), traitées au fil de l’eau avant même d’avoir été stockées

(Vélocité).

LES 3 V RECETTE DU BIG DATA

A LIRE PAGE 4

PARLEZ-VOUS LE BIG DATA?

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPB

N°02 / OCTOBRE 2015

NICOLAS ROUTIER

Directeur Général adjoint du Groupe La Poste

Membre du Comité de surveillance de La Banque Postale

édito

A LIRE PAGE 6

LES AUTORITÉS DE CONTRÔLE ET LE BIG DATA : MORCEAUX CHOISIS

AU MÊME MOMENT, ONT ÉTÉ ENVOYÉS ENVIRON

1.5 MILLIONS DE TWEETS ET

1 MILLIARD DE MAILS...

LESQUELS ALIMENTERONT CERTAINEMENT DES

TRAITEMENTS BIG DATA.

5 minutesC’est le temps que vous avez mis pour lire cet article :

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPBN°02 / OCTOBRE 2015

2

»

Les Algorithmes..... S’ils sont indispensables au Big Data, certains d’entre eux font également naitre beaucoup d’interrogations quant à leurs impacts sur nos libertés individuelles. Je veux parler des algorithmes prédictifs.

Nous sommes tous entrainés dans un maelstrom permanent d’informations dont le traitement s’appuie sur des systèmes construits à partir d’algorithmes.

Mystérieux et invisibles pour les non-initiés, les algorithmes, dont l’existence remontent aux babyloniens, peuvent se définir comme une méthode qui permet de résoudre un problème en le scindant en différentes étapes.

Par exemple, une simple recette de cuisine pourrait se définir par un algorithme, les différents points de sa réalisation permettant d’obtenir un résultat. Il est donc possible de trier des objets, rechercher un mot, situer une ville sur une carte, détecter des éléments annonciateurs de pannes ou proposer des offres particulièrement ciblées etc… grâce à une telle méthode.

Dans le cadre du e-marketing, il est envisageable de

cibler les individus, les consommateurs et en combinant l’analyse de leurs données avec des statistiques prédictives… de prédire leurs comportements.

LES ALGORITHMES SONT-ILS UN DANGER POUR NOS LIBERTÉS FONDAMENTALES ?

Plus rien n’échappe à leur mécanique ! Sans eux, l’internaute serait perdu dans la masse de données et d’informations livrée sur Internet. Ils sont indispensables… et nous ne saurions-nous en passer. Mais pour certains d’entre eux, dont l’objectif est de s’approcher au plus près de l’individu et de ce qu’il est …il convient d’être prudent et de mettre en place des gardes fous.

L’observation des résultats issus de l’utilisation de certains algorithmes, met en évidence une connaissance accrue et affinée des individus et plus particulièrement des éléments de leur vie privée allant même jusqu’à l’intime.

Dans cette perspective, et comme le précise le Conseil d’Etat1, comment ne pas s’inquiéter des risques éthiques qui pourraient naitre :

• de la confiance aveugle et sans discernement, dans les résultats élaborés par des algorithmes, perçus comme objectifs et infaillibles ;

• de la personnalisation « artificielle » liée à l’analyse des moindres comportements, ayant pour effet de créer un enfermement de l’individu, limitant ses possibilités d’expérience ;

• de l’exploitation de plus en plus fine des données personnelles, faisant naître un possible déséquilibre en terme d’équité, pouvant aller jusqu’à la discrimination.

(1) Rapport annuel : Le numérique et les droits fondamentaux [en ligne]. Conseil d’Etat, 9/09/2014 [consulté le 26/10/2015].

Protection des données personnellesFaut-il créer un droit des algorithmes?

« DANS LE CADRE DU E-MARKETING, IL EST POSSIBLE DE CIBLER

LES CONSOMMATEURS ET DE PRÉDIRE LEURS

COMPORTEMENTS

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPBN°02 / OCTOBRE 2015

3

Mais aussi des risques juridiques, liés au non-respect des règles de protection des données personnelles.

L’ÉBAUCHE D’UN FUTUR DROIT DES ALGORITHMES ?

C’est en veillant au respect des règles fondamentales, mises en place depuis plusieurs décennies, pour protéger l’utilisation de nos données personnelles2, complétées par des dispositions spécifiques liées à l’utilisation de certains algorithmes que nous pourrons éloigner ces risques.

Conscients des conséquences que peut faire naitre une utilisation sans contrainte des algorithmes, dont l’objectif est de cibler au plus près les individus tant dans un but commercial que sécuritaire, le Règlement Européen relatif à la Protection des Données Personnelles, ainsi que le projet de Loi pour une République Numérique, dont l’adoption devrait intervenir, pour l’un et l’autre début 2016, prévoient :

• Une obligation de transparence, se traduisant par une information préalable donnée à l’individu par le responsable de traitement sur les types de données personnelles utilisées et sur la logique suivie par l’algorithme choisi ;

• Des modalités particulières pour les prises de décision,

(2) Loi n° 78-17 du 6 janvier 1978 relative à l’informatique, aux fichiers et aux libertés et Directive 95/46/CE du Parlement européen et du Conseil, du 24 octobre 1995, relative à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données

appelant l’exigence d’une intervention humaine réelle, effective et non simplement formelle, lors de la prise d’une décision, produisant potentiellement des effets juridiques ; le seul automatisme des résultats ne devant pas commander la décision finale ;

• Le respect du principe du contradictoire en donnant la possibilité à chaque individu, de faire valoir ses observations face à une décision finale, afin de pouvoir contrer les arguments issus de l’analyse liée à l’utilisation des algorithmes et le cas échéant de s’opposer à cette décision.

Ces dispositions préfigurent certainement l’élaboration d’un véritable droit des algorithmes prédictifs » comme l’appelle de ses vœux le Conseil d’Etat aux termes de son rapport3 : « Face aux risques qu’ils présentent, il convient de définir un véritable droit des algorithmes prédictifs ».

En attendant, il convient de rester vigilant et de suivre pas à pas les évolutions de ces merveilleux outils, car si à date, ils ne permettent pas encore d’imiter parfaitement l’esprit humain …… que nous réservent-ils à l’avenir ?

Françoise Loizy

Adjoint Correspondant Informatique et Libertés

(3) Op. cit., p.4

LE RÈGLEMENT EUROPÉEN RELATIF À LA PROTECTION DES DONNÉES PERSONNELLES ET LE PROJET DE LOI POUR UNE RÉPUPUBLIQUE NUMÉRIQUE ÉBAUCHENT UN FUTUR DROIT DES ALGORITHMES

Protection des données personnellesFaut-il créer un droit des algorithmes? (suite)

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPBN°02 / OCTOBRE 2015

4

A

ALGORITHME : Un algorithme est une suite d’opérations ou d’instructions à appliquer dans un ordre déterminé et permettant de résoudre un problème ou d’obtenir un résultat donné.Le mot algorithme vient du nom du mathématicien perse Al-Khawarizmi (latinisé au Moyen-Âge en Algoritmi) et qui introduit en Occident vers l’an 820 la numération décimale rapportée d’Inde.

A U T O D É T E R M I N A T I O NINFORMATIONNELLE (cf. infrasérendipité) : « Toute personne dispose du droit de décider des usages qui sont faits de ses données à caractère personnel et de les contrôler, dans les conditions et limites fixées par les lois et règlements en vigueur » (art. 16 du projet de loi pour une république numérique).

C

CONSENTEMENT : La personne dont on traite les données doit y avoir consenti, sauf si les données ont été manifestement rendues publiques par elle (mur Facebook par exemple)… et sauf si le traitement est nécessaire aux intérêts légitimes de l’entreprise.

CNIL : CNIL est l’acronyme pour Commission Nationale Informatique et Libertés. Autorité administrative en charge du contrôle de la bonne application de la loi Informatique et Libertés (I&L).

D

DATA : « Prenez toutes les informations produites par l’humanité depuis l’aube des temps jusqu’en 2003. Maintenant, nous produisons la même quantité en

tout juste deux jours »1. La donnée est le carburant qui alimente le big data.

DONNÉES À CARACTÈRE PERSONNEL (voir propriété) : «Constitue une donnée à caractère personnel toute information relative à une personne physique identifiée ou qui peut être identifiée, directement ou indirectement, par référence à un numéro d’identification ou à un ou plusieurs éléments qui lui sont propres »2. La notion demeure opérante avec le Big Data.

F

FINALITÉ : On collecte les données pour une utilisation fixée à l’avance (art.6 , &2 de la loi I&L3) : lutte anti-fraude, personnalisation des offres, villes intelligentes, etc.. La finalité doit être licite et ne pas conduire à une discrimination (cf infra profiling). La possibilité de traiter des données pour plusieurs finalités spécifiques et non incompatibles a cependant été retenue par le RGPD4.

G

G29 : association regroupant les autorités de contrôle de l’UE et présidée par Isabelle Falque-Pierrotin, Présidente de la CNIL depuis le 27 février 2014.

GAFA : Google, Apple, Facebook et Amazon, les grands collecteurs de données, notamment les moteurs de recherche, ont été confrontés il y a une dizaine d’années à une augmentation très rapide du nombre des données aux formats

(1) Neelie Kroes, vice-présidente de la Commission européenne en charge de l’agenda numérique - 7 novembre 2013.(2) Pour plus de précisions sur cette définition voir : Groupe de travail « article 29 » sur la protection des don-nées, Avis 4/2007 sur le concept de données à caractère personnel, 20 juin 2007; 01248/07/FR, WP 136.(3) Loi Informatique et Libertés(4) RGPD : Règlement Général sur la Protection des Données dont le texte sera finalisé fin 2015 pour une adoption en jun 2016 et qui remplacera la loi I&L

très divers, les incitant à rechercher de nouvelles technologies pour les traiter. C’est ainsi que Google File System est devenu en 2004 le prototype opensource Hadoop. Puis sont venus HDFS, MapReduce, Hbase, Hive, noSQL, etc) ...donnant au praticien du Big Data, ainsi dénommé en 2008, sa boîte à outils.

I

INFORMATION : L’information préalable des personnes au traitement de leurs données est obligatoire (art. 39) mais, même averties, celles-ci n’ont pas bien souvent l’expertise nécessaire pour les protéger et contrôler l’usage qui en sera fait. C’est à l’entreprise de trouver le meilleur moyen de communiquer avec elles pour leur fournir une information suffisante et pédagogique dans sa formulation, afin d’obtenir un vrai consentement des individus (cf supra consentement) sur leurs données personnelles et le gérer (cf infra Transparence) au moment de la collecte de leurs données et ultérieurement.

IoT : Internet of Things ou Internet des Objets : objets connectés à internet qui transmettent des données. Ces objets peuvent communiquer entre eux. Smartphones, Montres, Bracelets, Lunettes, Vêtements, compteurs d’électricité, d’eau, etc. Toutes ces données alimentent les applications dites Big Data.

L

LICÉITÉ : la licéité des traitements dans le cadre d’un projet Big Data trouve son fondement dans le consentement de la personne concernée par le traitement et dont les données collectées l’ont été de façon loyale, c’est à dire que les informations nécessaires lui ont été

LexiqueParlez-vous le Big Data?

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPBN°02 / OCTOBRE 2015

5

LexiqueParlez-vous le Big Data?(suite)

communiquées notamment en ce qui concerne son droit d’opposition au traitement.

M

MINIMISATION : La minimisation s’applique à la typologie des données et non à la quantité des données traitées ; si le principe de proportionnalité (cf infra) ne permet pas de collecter plus de données que nécessaires à l’usage, il n’en interdit pas leur traitement en très grand nombre (ou volume).

O

OCTET : 1 octet représente 256 valeurs différentes.

OPEN DATA : ou données ouvertes. Données qu’un organisme met à la disposition de tous sous forme de fichiers numériques afin de permettre leur réutilisation. Les données ouvertes n’ont généralement pas de caractère personnel et dans le cas contraire l’anonymisation est explicitement prévue.

P

PROFILAGE : Si la finalité du traitement (cf. supra finalité) est le profilage (identification de personnes selon des critères pré-définis), le traitement ne peut

être réalisé que si la personne a donné son consentement (cf supra consentement) et qu’elle bénéficie de garanties appropriées. Elle doit être notamment dûment informée de la finalité du traitement et pouvoir s’y opposer. Il convient alors de s’assurer que le profilage des individus ne crée pas de discrimination ce qui serait contraire à la règlementation.

PROPORTIONNALITÉ : Seules les données nécessaires à la poursuite de la finalité du traitement peuvent être traitées par l’entreprise. C’est ce qu’il ressort des dispositions du paragraphe 3 de l’article 6 de la loi Informatique et Libertés.

P R O P R I É T É DES DONNÉES PERSONNELLES :Selon une étude Havas Media Group5, 84 % des personnes interrogées se prétendent inquiètes de l’usage qui peut être fait de leur données, 30 % se disent néanmoins prêtes à y donner accès pour 500 € par an. Le Conseil d’Etat dans son rapport annuel 20146, s’élève contre une possible marchandisation de l’humain. Idem pour le Conseil National du Numérique7. La Cour de cassation a jugé que les données peuvent être considérées comme des biens8.

S

SÉCURITÉ : Pour une illustration de ce que représentent, dans le monde, (5) Benjamin Ferran. Les Français prêts à monnayer leurs données personnelles Le Figaro [en ligne], 26/09/2014 [consulté le 26/10/2015].(6) Rapport annuel : Le numérique et les droits fonda-mentaux [en ligne]. Conseil d’Etat, 9/09/2014 [consulté le 26/10/2015].(7) Rapport Ambition numérique [en ligne]. Conseil Natio-nal du Numérique, Juin 2015 [consulté le 26/10/2015].(8) Cass. Crim., 22 octobre 2014, n°13-82630.

les failles de sécurité : http://www.informationisbeautiful.net/visualizations/worlds-biggest-data-breaches-hacks/

SÉRENDIPITÉ (cf. supra a u t o d é t e r m i n a t i o n informationnelle) : Illustration de l’adage « le hasard fait bien les choses ». Peu importe les données traitées, leur qualité, leur nature, et leur variété doivent permettre d’obtenir in fine des informations utiles, même si leur découverte est le fruit du hasard.

T

TRANSPARENCE : ce principe repose sur la nécessité d’une information renforcée de l’internaute, ce sur quoi renchérit le RGPD (Règlement général sur la protection des données) en prévoyant l’utilisation de pictogrammes permettant à la personne concernée de comprendre par l’image les finalités du traitement.

Xavier Lemarteleur Responsable juridique TIC -

Branche numérique

Emmanuel Jouffin Responsable Dépt Veille

règlementaire Groupe LBP

Les trois piliers du Big data

SUPPLÉMENT AU BULLETIN D’INFORMATION DE LA FILIÈRE JURIDIQUE DU GROUPE LPBN°02 / OCTOBRE 2015

6

«Lors d’un communiqué de presse en date du 11 juin 2014, le Groupe G29 indique qu’il n’a pas raison de croire en l’état actuel des choses que les principes de protection des données tels que présents dans la Directive 95/46/CE sont fondamentale-ment mis en causes par les déve-loppements du Big Data.

PAROLES DU G29

« Morceaux choisis » les autorités de contrôle et le Big Data

Isabelle Falque Pierrotin, Présidente de la CNIL

Comment la CNIL perçoit-elle ce que l’on appelle le big data ?

« La question que pose le Big Data est de savoir si notre régulation est assez robuste pour digérer cette phase nouvelle de l’univers numérique. Je suis convaincue que oui ».

« La position de la Cnil, contrairement au ressenti général, n’est pas figée. L’idée que la Cnil s’opposerait systématiquement à la lutte contre la fraude ou qu’elle s’opposerait aux aspects positifs en terme d’innovation qu’apporte le big data, n’est pas étayée par la réalité. À chaque fois qu’elle a été saisie d’une demande, elle a trouvé une réponse. Ces sujets (l’interconnexion de fichiers, la segmentation toujours plus fine des clients), ne sont pas, en soi, contraires à la Loi informatique et libertés. La seule chose que demande celle-ci,

ce sont des garanties en termes de liberté des individus ».

« La question que pose le Big Data n’est donc pas de changer nos principes mais de travailler sur de nouveaux outils d’encadrement qui donneront d’ailleurs aux entreprises un avantage concurrentiel Et ces garanties peuvent aussi être porteuses de valeur ajoutée pour l’entreprise. Aujourd’hui, dans la relation client, il me semble que la ressource rare, c’est le client lui-même. Si celui-ci n’a pas confiance dans l’offreur de service, que ce soit un prestataire d’assurance, un commerçant électronique... il peut changer de fournisseur. Il y a une volatilité beaucoup plus forte, du fait du numérique, des consommateurs et des clients. La protection des données personnelles est un élément de construction d’une relation de confiance et de qualité avec des clients qui s’attachent ainsi à leurs prestataires ».

Extrait de l’entretien réalisé par Arnaud Chneiweiss et Daniel Zajdenweber en Juin 2014, in Les cahiers de l’Assurance.

Résolution Big Data - 36e Conférence Internationale des Commissaires à la protection des données et de la vie privée.

Du 13 au 16 octobre 2014, la commissaire mauricienne, Mme Drudeisha Madhub accueillait ses homologues dans le cadre de la 36e Conférence Internationale des Commissaires à la protection des données et de la vie privée : Un ordre mondial pour la protection des données : un rêve qui devient réalité. Lors de cette conférence différentes résolutions ont été adoptées dont une sur le Big Data.

La 36e Conférence Internationale des Commissaires à la protection des données et de la vie privée

appelle, avec sa résolution sur le Big Data, au respect du principe de finalité, au respect du principe de minimisation des données, à l’obtention d’un consentement valide, à la transparence, à l’utilisation des technologies Big Data en respectant le principe de vie privée par défaut, à l’utilisation de techniques d’anonymisation, à limiter et contrôler l’accès aux données pseudonymes.

CE QU’EN DISENT LES COMMISSAIRES DE LA PROTECTION DES DONNÉES DE LA VIE PRIVÉE

ENTRETIEN DE LA CNIL

par Marie-Noëlle GibonCorrespondant Informatique et Libertés

»Pour vous abonner [email protected]